{賭波}(分词器原理)

- 21

- 2023-02-04 09:51:30

- 17

word分词是一个Java实现的分布式的中文分词组件,提供了多种基于词典的分词算法,并利用ngram模型来消除歧义如果需要安装word分词器可以参考下面的步骤1确保电脑上已经安装了JDK软件和Eclispe工具,没有安装的可以到对应的。

随着深度学习的兴起,也出现了 基于神经网络的分词器 ,例如有人员尝试使用双向LSTM+CRF实现分词器, 其本质上是序列标注 ,所以有通用性,命名实体识别等都可以使用该模型,据报道其分词器字符准确率可高达975%算法框架的思路与论文Neura。

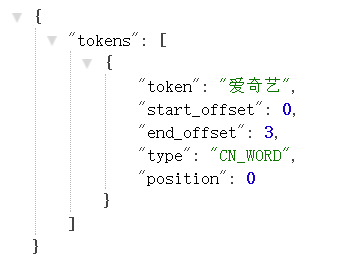

这些算法称为 Tokenizer分词器 , 这些Token会被进一步处理, 比如转成小写等, 这些处理算法被称为 Token Filter词元处理器 ,被。

es的分词器往往包括3个低级构建块包Standard Analyzer 标准分析仪按照Unicode文本分段算法的定义,将文本分割成单词边界的分词它删除了大多数标点符号,小写显示分词,并支持删除stop wordsSimple Analyzer 当遇到不是字母的。

修改分词器设置 启用stardar停用词token filter,在stardard中stop token filter是默认被禁用的 定制化自己的分词器 在指定的type里面用定制化的分词器。

原理如下1第一步,在 webpack 的 watch 模式下,文件系统中某一个文件发生修改,webpack 监听到文件变化,根据配置文件对模块重新编译打包,并将打包后的代码通过简单的 JavaScript 对象保存在内存中2第二步是 web。

将原始文本进行分词,例如 小白最帅 = 小白,最,帅 Elasticsearch自带的分词器 分词器Analyzer 特点 standardes默认 支持多语言,按词切分并做小写处理 simple 按照非字母切分,小写处理 whitespace 按照空格来切分 stop 去。

发表评论